Спрос на процессоры для агентного ИИ может усугубить дефицит на рынке оперативной памяти

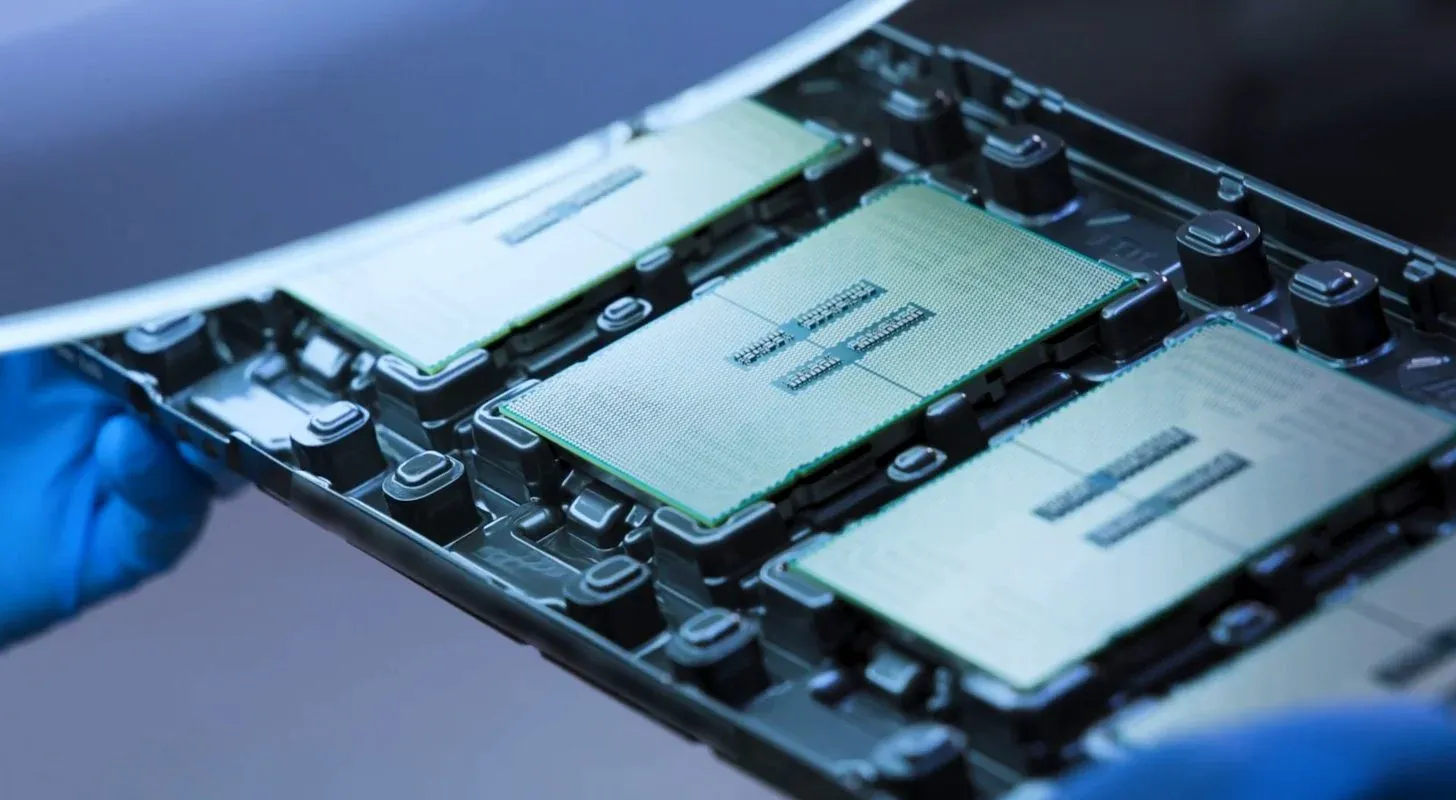

Как сообщает SE Daily со ссылкой на отраслевые источники, производители центральных процессоров планируют оснащать свои будущие чипы для ИИ памятью объемом от 300 до 400 ГБ, что значительно превышает текущие показатели (96–256 ГБ на чип).

Традиционно для обучения и работы ИИ-моделей использовались преимущественно графические процессоры. Однако развитие агентного ИИ, требующего более сложных логических вычислений, привело к изменению соотношения между видеокартами и центральными процессорами в серверных стойках. Если раньше это соотношение составляло 8:1 (GPU к CPU), то сейчас оно снизилось до 4:1. Аналитики прогнозируют, что в ближайшем будущем пропорция может достичь 1:1.

При этом центральным процессорам для работы с агентным ИИ требуются колоссальные объемы памяти. Точный формат реализации пока не уточняется. Это может быть как упаковка CPU совместно с памятью стандарта HBM (или перспективными стандартами HBF/ZAM), так и создание сверхъемких модулей DIMM нового поколения (например, MRDIMM).

В любом случае, объем оперативной памяти на один CPU может превысить показатели флагманских графических ИИ-ускорителей, таких как NVIDIA GB300 или AMD MI350X (оснащенных 288 ГБ памяти HBM3E).

Конкуренция за объемы памяти уже затрагивает новые разработки крупнейших IT-гигантов:

- Чип NVIDIA следующего поколения Vera Rubin получит 288 ГБ (8 модулей HBM)

- Будущий GPU от AMD — MI400 — будет оснащен 432 ГБ памяти

- Новый кастомный чип Google TPU 8i также ожидается с 288 ГБ HBM

Внедрение процессоров Intel Xeon и AMD Epyc с поддержкой сверхемких модулей DDR5 на фоне общего роста требований к памяти грозит серьезными последствиями для рынка комплектующих.

Производители памяти уже получают сверхприбыли, но не справляются с растущим спросом. Несмотря на расширение производственных мощностей, новые фабрики пока не введены в эксплуатацию. Ранее представители Samsung заявляли, что ситуация с дефицитом DRAM в 2027 году может оказаться еще хуже, чем в 2026-м.

Кроме того, фокус производителей на создании плотных и высокомаржинальных чипов памяти для нужд ИИ приводит к сокращению производства более доступных и массовых модулей (как это уже произошло с отказом Samsung от производства LPDDR4 в пользу LPDDR5).

Аналитики опасаются, что перераспределение производственных линий в пользу премиального сегмента спровоцирует еще больший дефицит и рост цен на оперативную память для потребительских ПК и других сегментов рынка, не связанных с ИИ.

Залогиньтесь, чтобы писать комментарии